Rozwój modeli AI znacząco wpłynął na sposób pracy w obszarze Threat Intelligence, przyspieszając analizę danych i automatyzując wiele zadań. Jednak za tą efektywnością stoją pewne ograniczenia, które wpływają na jakość i wiarygodność wniosków, które czasami mówiąc łagodnie – są ślepo wygenerowane i zmyślone.

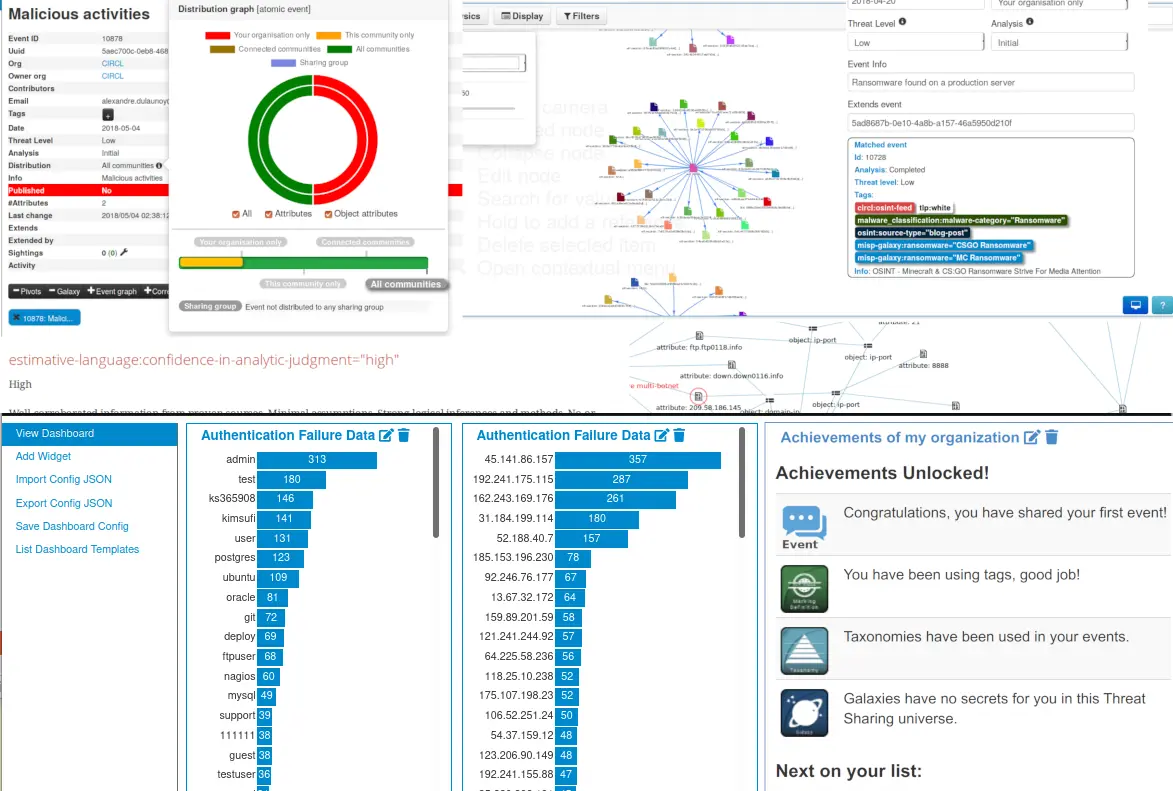

Aby to potwierdzić przytoczę artykuł, który omawia ograniczenia modeli językowych w kontekście Threat Intelligence. Popularnym projektem Threat Intelligence jest MISP (Malware Information Sharing Platform & Threat Sharing) jako otwarte oprogramowanie przeznaczone do gromadzenia, udostępniania i analizy informacji związanych z cyberzagrożeniami. MISP może być dostosowywany do indywidualnych potrzeb każdej organizacji.

Głównym celem MISP jest umożliwienie dzieleniem się informacjami na temat zagrożeń cybernetycznych, które obejmują IoC (Indicators of Compromise), TTP (Tactics, Techniques, Procedures) oraz innymi informacjami związanymi z incydentami bezpieczeństwa.

MISP oferuje też narzędzia do wizualizacji i analizy danych, które pomagają organizacjom zrozumieć i reagować na zagrożenia. Możliwe jest tworzenie grafów relacji między danymi, co ułatwia identyfikację i lepsze rozpoznanie incydentów. Rozwiązanie posiada wsparcie dla standardów STIX i TAXII, więc ułatwia integrację i wymianę danych z innymi narzędziami i platformami bezpieczeństwa.

Projekt MISP wykorzystujemy w AVLab do zbierania informacji o zagrożeniach, które następnie używamy w testach. MISP jest też używany przez wiele organizacji na całym świecie, w tym rządowe agencje, firmy prywatne i instytucje badawcze.

Ów artykuł wskazuje na problemy, jakie stwarza korzystanie z AI do analizy zagrożeń. Współcześnie LLM-y są coraz częściej wykorzystywane w badaniach – ich działanie opiera się na przewidywaniu kolejnych słów, a nie na rzeczywistym rozumowaniu czy analizie śledczej. W efekcie prowadzi to do niespójnych i trudnych do zweryfikowania wniosków.

Jednym z kluczowych problemów jest brak tzw. deterministycznej logiki. Chodzi o to, że te same pytania mogą prowadzić do różnych odpowiedzi, a różne modele potrafią generować sprzeczne interpretacje tego samego przypadku.

Kolejnym istotnym ograniczeniem są tzw. halucynacje (jak określa autor). Modele potrafią tworzyć nieistniejące fakty, kampanie, powiązania między grupami APT czy nawet wskaźniki kompromitacji. Problem polega na tym, że takie odpowiedzi są często przekonujące i stylistycznie poprawne, co może wprowadzać analityków w błąd i prowadzić do błędnych decyzji operacyjnych.

Modele nie posiadają również kontekstu operacyjnego. Nie mają dostępu do rzeczywistej telemetrii, nie znają specyfiki organizacji ani jej priorytetów. W związku z tym generują odpowiedzi ogólne, które mogą być poprawne teoretycznie, ale nieprzydatne w praktyce. Brakuje im zdolności do dopasowania analizy do konkretnego incydentu.

Istotnym problemem jest także płytkość analizy. Threat Intelligence wymaga łączenia informacji z wielu źródeł, przykładowo w analizie kampanii phishingowej analityk musi połączyć:

- URL i domeny,

- dane z EDR (procesy, parent-child),

- WHOIS i DNS (wiek domeny, infrastruktura),

- sandbox (zachowanie zagrożenia),

- źródła TI (np. powiązania z wcześniejszymi kampaniami).

Dopiero na tej podstawie możliwe jest ustalenie czy domena została zarejestrowana wcześniej, czy malware używa znanych technik konkretnej grupy, czy infrastruktura atakującego pokrywa się z jakimiś kampaniami. Modele językowe nie realizują tego procesu w sposób rzeczywisty, lecz jedynie odtwarzają wzorce językowe.

Szczególnie widoczne jest to w obszarze atrybucji. Modele często przypisują działania do znanych grup bez wystarczających dowodów lub łączą kampanie na podstawie powierzchownych podobieństw. Takie uproszczenia mogą prowadzić do błędnych wniosków strategicznych.

Dodatkowym ryzykiem jest podatność na manipulacje. Odpowiedzi modeli mogą być kształtowane przez sposób zadania pytania, co otwiera możliwość ich wykorzystania do generowania fałszywych analiz.

Modele mają również ograniczenia związane z aktualnością danych i kontrolą źródeł. Mogą łączyć informacje pochodzące z różnych okresów i nie zawsze są w stanie wskazać ich wiarygodne pochodzenie.

Mimo tych ograniczeń artykuł wskazuje, że modele językowe mogą być użyteczne jako narzędzie pomocnicze. Sprawdzają się w zadaniach takich jak streszczanie raportów, ekstrakcja danych czy wsparcie dokumentacji. Nie powinny jednak być wykorzystywane jako samodzielne źródło wiedzy ani do podejmowania decyzji operacyjnych.

Największym problemem nie jest to, że modele się mylą, lecz to, że robią to w sposób przekonujący. W Threat Intelligence może to prowadzić do budowania błędnych wniosków i podejmowania niewłaściwych decyzji. Bezkrytyczne zaufanie do AI może być szkodliwe.

Czy ten artykuł był pomocny?

Oceniono: 0 razy